Sounddesign in Spielen

Um ein einheitliches Sounddesign in Spielen und ein umfassenderes Verständnis der Abfolge von Geräuschen zu erreichen, können diese in verschiedene Typen unterteilt werden: Sprachausgabe, Atmosphären (Umgebungsgeräusche), synchrone Geräusche (Fols), Soundeffekte (CFX) und Musik.

Es gibt verschiedene Möglichkeiten, Sprache in Spielen zu verwenden. Gesprochene Dialoge dienen den Benutzern als Hauptinformationsquelle. Ansagerphrasen belohnen den Spieler (z. B. „Double Kill“) oder kündigen bestimmte Aktionen an („Runde eins – Kampf“). Die Sprachausgabe der Aktionen des Hauptcharakters, wie zum Beispiel Schreien beim Erleiden von Schaden oder Springen, Atemgeräusche beim Laufen, trägt dazu bei, die Verbindung zum Charakter zu stärken und seinen Zustand besser zu vermitteln.

Bei der Arbeit mit Synchronsprechern ist es wichtig, Schauspieler mit einem geeigneten Timbre auszuwählen, damit ihre Stimme zum Charakter der Figur passt. Die Stimme des NPCs soll beim Spieler ein Gefühl für die Realität hervorrufen. Wenn es sich bei der Figur um ein Monster oder einen Außerirdischen handelt, sollten die Besonderheiten der Aussprache und die Besonderheiten des Sprachapparats hervorgehoben werden. Zu diesem Zweck verwenden Sounddesigner Tonhöhenverschiebungs- und Sound-Layering-Tools wie Pitch und Layering. Mit diesen Werkzeugen können Sie die Tonhöhe und -dauer des Klangs ändern sowie Kompositionen aus verschiedenen Ebenen und Texturen erstellen. Darüber hinaus ist der Einsatz von Effekten zu berücksichtigen.

Sprachausgabe in einem Spiel ist normalerweise entweder mit einem Dialogbaum oder einem Auslöser verbunden.

Um Atmosphäre zu schaffen, ist es wichtig, geloopte Audio-Samples zu verwenden, bei denen das Ende der Audiodatei fließend in den Anfang übergeht. Es ist wichtig, darauf zu achten, dass es keine wahrnehmbaren Sprünge gibt, und Sounds zu verwenden, die mindestens eine Minute (vorzugsweise mindestens fünf Minuten) lang sind, um die Illusion eines kontinuierlichen Hintergrundsounds zu erzeugen. Jeder abrupte Übergang kann das Eintauchen des Spielers unterbrechen.

Beim Hinzufügen von Hintergrundgeräuschen zur virtuellen Welt ist es wichtig, deren Positionierung auf der Karte zu berücksichtigen. Wenn es sich beispielsweise um einen Dschungelstandort handelt, sollten allgemeine Geräusche wie Vogelgezwitscher, Wasserfallgeräusche und Rascheln immer vorhanden sein. Jedes Objekt verfügt über eine eigene Klangzone, die in zwei Ebenen unterteilt werden kann: die Anstiegszone und die Zone mit konstanter Lautstärke. Dieser Vorgang wird als Dämpfung bezeichnet.

Wenn der Spieler die erste Zone betritt, nimmt die Lautstärke des Tons zu, je näher er der Quelle kommt.

Dieser Vorgang wird fortgesetzt, bis der Benutzer nah genug herankommt. Anschließend wechselt der Spieler in die zweite Zone, wo die Lautstärke unverändert bleibt. Dies ist wichtig für die Positionierung und Überblendung von Zonen, da sich Töne aus verschiedenen Quellen überlappen können. Hintergrundgeräusche werden direkt an den Standorten platziert, wobei darauf zu achten ist, dass sie nicht über deren Wirkungsbereich hinausgehen. Bei der Schaffung einer Orientierungsatmosphäre in der Spielwelt werden folgende Parameter berücksichtigt:

- Lautstärke: Lautstärkepegel;

- Positionierung: Bestimmung des Schallortes im Raum;

- Priorität: Bestimmung der Bedeutung des Geräusches im Vergleich zu anderen Geräuschen;

- Hall: Reflexion von Schall in geschlossenen Räumen, wodurch ein Echo entsteht.

Bei der Arbeit mit Sound ist es wichtig, auf die Hauptspielelemente, die sogenannten Akzente, zu achten, die das Benutzererlebnis prägen. Hierfür sind Tonmischungs- und Priorisierungsverfahren sinnvoll.

Wenn beispielsweise ein Feind auftaucht, müssen die Geräusche, die er macht, deutlich vom Hintergrund der Umgebung unterschieden werden. Es gibt verschiedene Möglichkeiten, diese Aufgabe zu lösen:

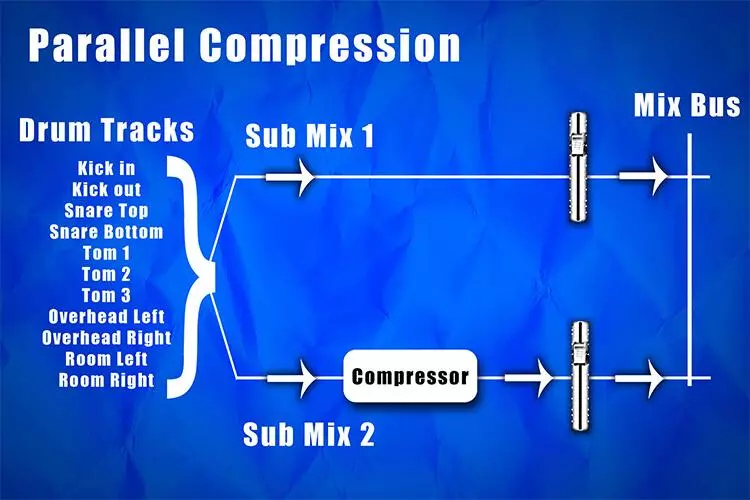

- Verteilung von Klangschichten auf verschiedene Audiokanäle und deren Mischung;

- Priorisierung von Sounds basierend auf der Spiellogik.

Verwendung des Sidechain-Effekts, mit dem Sie die Lautstärke der Sounds je nach Priorität ändern können. Wenn beispielsweise ein Feind auftaucht und seine Geräusche von sich geben, werden andere laute Geräusche automatisch ausgeblendet.

Auch bei der Positionierung von Sounds auf einer Karte ist der Hall von großer Bedeutung. Es ist wichtig zu bedenken, dass ein Geräusch, beispielsweise ein Fingerschnippen, aufgrund der Reflexionen von Wänden und Oberflächen in einem Raum und in einer Höhle unterschiedlich klingen kann. Das Reverb-Tool kann Ihnen bei dieser Aufgabe helfen.

Hallzonen entsprechen normalerweise den Räumen, in denen sich die Atmosphären befinden, und können miteinander interagieren. Es ist wichtig, die Einheitlichkeit des Raums für alle Klangebenen in der Szene sicherzustellen und den Hall als Hauptwerkzeug zur Erzeugung des Klangansatzes und des Entfernungseffekts zu verwenden.

Synchrone Geräuschaufnahmen (Foley) werden häufig im Studio durchgeführt, um Authentizität und eine hohe Klangqualität zu erreichen. In der Vergangenheit war die Verwendung von Audioaufnahmen am Set aufgrund des Rauschens der Kameras schwierig. Jack Foley, ein amerikanischer Toningenieur in der Filmindustrie, entwickelte ein System, bei dem der Ton getrennt vom Video auf dem Bildschirm, aber synchron mit diesem aufgezeichnet wurde.

Mittlerweile werden Synchrongeräusche auch in spezialisierten Studios erzeugt. Um den gewünschten Klang zu erzielen, ist es nicht notwendig, natürliche Materialien zu verwenden. Beispielsweise kann mit Papier und speziellen Soundeffekten das Geräusch von Elektrizität nachgeahmt werden, oder mit einem Beutel Stärke kann das Geräusch von Schnee erzeugt werden.

Der effizienteste Weg, synchrone Geräusche zu verknüpfen, besteht darin, sie direkt der Animation zuzuordnen. Um beispielsweise das Geräusch der Schritte der Figur ertönen zu lassen, müssen Sie den Moment bestimmen, in dem der Fuß die Oberfläche berührt, und diesem Moment das entsprechende Geräusch zuordnen. Es ist wichtig, den richtigen Ton zu wählen, der vom Material abhängt, auf das die Figur tritt.

SFX sind Soundeffekte, die in der Realität nicht vorkommen: Geräusche von Außerirdischen, Raumschiffen sowie Akzente, auf die der Spieler achten sollte – Explosionen, Schüsse, Interface-Sounds. Es ist sehr wichtig, dass SFX zum Setting des Spiels passt. Beispielsweise können Sie beim Erstellen von Interface-Sounds Sounds mit derselben Textur (Glas, Stein, Holz) verwenden, um einen einheitlichen Klang zu gewährleisten.

SFX werden auf die gleiche Weise wie Soundeffekte an Orten platziert oder können an bestimmte Auslöser oder Animationen gebunden werden.

Musik wird verwendet, um in einer Szene eine bestimmte Stimmung zu erzeugen. Sie vermittelt die Gefühlslage und Dramaturgie perfekt. Musik kann im Bild (die Tonquelle befindet sich in der Szene: Grammophon, Klavier) oder außerhalb des Bildschirms sein. Die Platzierung der Musik erfolgt analog zu den Hintergrundgeräuschen. Es wird fast immer in Zwischensequenzen verwendet und ist eine einfache und effektive Möglichkeit, das Audiodesign in Spielen miteinander zu verbinden.

Musik in Spielen wird normalerweise in zwei Arten unterteilt:

- Adaptive Musik;

- Lineare Musik.

Adaptive Musik wird verwendet, um nahtlos mit dem Gameplay zu interagieren und die Intensität und Dramatik des Geschehens anzupassen. Um dies zu erreichen, ist es jedoch notwendig, fließende Übergänge zwischen verschiedenen Segmenten der Komposition zu schaffen.

Zum Beispiel haben wir ein gelooptes Musiksegment A, das mit einem einfachen Gang der Figur verbunden ist. Wenn sich der Spieler der Lava nähert und den Auslöser betätigt, beginnt Teil B. Um einen reibungslosen Übergang zu gewährleisten, ist es notwendig, zunächst die Möglichkeit einer Zusammensetzungsänderung in Betracht zu ziehen.

Es gibt einen horizontalen Übergangstyp, der den Übergang vom ersten zum zweiten, vom zweiten zum dritten usw. umfasst. Jedes Segment ist in Teile unterteilt, die ihre eigenen Übergangsbedingungen zum nächsten haben. Beispielsweise kann ein spezieller Schlussteil aufgenommen werden, der beim Wechsel in ein anderes Segment eingebunden wird.

Es gibt auch eine vertikale Methode, bei der eine gemeinsame Hintergrundmelodie verwendet wird, die durch andere musikalische Ebenen ergänzt wird, wenn man sich an andere Orte bewegt oder das Spieltempo ändert. Beispielsweise kann eine modifizierte Version des Hauptthemas enthalten sein. Wichtig ist, dass alle diese Teile prägnant miteinander kombiniert werden und einen harmonischen Klang ergeben.

Um ein ausgewogenes Sounddesign in Spielen zu schaffen, ist es wichtig, bestimmte Grundsätze einzuhalten:

- Verwendung geeigneter Klangtexturen: Ersetzen Sie den Klang eines Kunststoffgegenstandes nicht durch den Klang eines Metallgegenstandes;

- Einhaltung des geplanten Schalls;

- Akzente setzen, um die Aufmerksamkeit auf Schlüsselelemente zu lenken;

- Berücksichtigung der Priorität von Geräuschen.

Darüber hinaus ist es wichtig, die Eigenschaften von Klang zu verstehen. Befindet sich das Luftschiff beispielsweise hinter einem Berg und ist es nicht sichtbar, aber hörbar, gibt es keine hochfrequenten Geräusche. Wenn das Luftschiff hinter dem Berg auftaucht, werden die Frequenzen ausgerichtet und es entsteht ein Nachhall, ein Echo aus der Schlucht. Je näher das Objekt ist, desto geringer ist das Echo. Je größer das Objekt, desto mehr tieffrequente Klangtexturen entsprechen ihm. Viele dieser Nuancen werden mit der Erfahrung deutlich.

Registrieren Sie sich kostenlos und erhalten Sie ein Projekt gratis