音楽のai

AIを搭載した音楽の可能性は長年にわたって音楽業界の表面の下をつぶやいてきましたが、AI周辺のより広い会話が主流に広がり始めたのは、2022年にChatGPTのリリースまでではありませんでした。私たちは今、一部のミュージシャンや音楽業界の専門家がAIを搭載した音楽の可能性に魅了されていますが、特に規制がまだ初期段階にある場合、他の人は未知のものに警戒しています。音楽配信会社Dittoによる調査では、調査対象のアーティストの60%近くが音楽プロジェクトでAIを使用していると答えているが、28%は音楽目的でAIを使用しないと答えています。

Berklee College of Musicの音楽ビジネス/管理部門の副議長であるChristopher Wearsは、AI Music Technologyの支持者です。彼は、2016年にワーナーミュージックがAIに投資すべき理由についての修士論文も書きました(ネタバレアラート:他のすべてのメジャーレーベルとともにそうしました)。 Waresはバークリーでの彼のコースにAIを導入し、学生からの混合反応を見ました。

「私の生徒の中には、AIが大好きで、すでにさまざまな方法でそれを使用している人もいますが、他の生徒はそれとは何の関係もありません」とWares氏は言います。 「会話には多くの激しい議論があります。私は、生徒がテクノロジーを受け入れ、創造的なプロセスを改善するためにそれを使用する新しい方法を見つけるように奨励しようとしています。」

同様の考え方を持つ別のコース著者であり、インストラクターは、バークリー音楽大学の作詞作曲の准教授であり、歌の著者であるベン・キャンプです。彼らは、AIがビートルズの音楽で訓練された最初のAIポップソングの1つである「Daddy's Car」を聞いた後、2016年以来AI Music Technologyに魅了されてきました。

また、キャンプは、ChatGPTまたは大規模な言語モデルから学習したすべての情報を事実チェックする限り、教室でAIを学ぶ機会を学生に与えます。

「誰もが自分で選択しなければならないと思います」とキャンプは言います。 「つまり、携帯電話にすべての情報を入手するのに満足していないため、フリップフォンをまだ使用している友人がいます。私にはまだ固定電話を持っている友達がいます。だから私は「ねえ、みんな、あなたはこれをする必要がある」と言っているのではない。しかし、それは間違いなくここにあります。消えていません。良くなるだけです。」

音楽でAIを積極的に使用している場合でも、疑問を抱いている場合でも、AIが将来音楽業界で大きな役割を果たすことがますます明らかになっています。製品とキャンプの専門知識により、現在利用可能なツールを含む音楽業界のAIの現状について説明します。

AI音楽とは何ですか?

AI Musicの意味を定義する前に、最初に人工知能を定義しましょう。 Walesの定義は次のとおりです。

「人工知能は、コンピューターの知能のようなものです。これは、マシンが問題解決、学習、パターンの認識など、人間の思考や行動を模倣できるようにする技術です。」

音楽の文脈では、AIテクノロジーは、以前に人間によって実行されていた音楽コンテンツを生成、構成、強化できるポイントに達しました。 AI Musicは、最初から最後まで曲全体を作成することから、作曲の特定の側面を作成したり、プロダクションの混合とマスタリング、音声クローニングなどを書くことまで、さまざまな形や種類の支援を受けることができます。また、これらのタスクを実行できる特定のAIミュージックツールもリストします。その機能により、パンドラの著作権問題の箱が開かれました。

歴史

人工知能は音楽に起源があり、転写の問題があります。パフォーマンスを音楽表記に正確に記録します。 PèreEngramelleの「ピアノテープ」スキームは、手で適切な音楽表記に簡単に転写できるように、ノート時間と期間を自動的に記録するモードであり、1957年にドイツのエンジニアJF UngerとJ. Holfieldによって最初に実装されました

。 Illiac I(Illinois Automatic Computer)は、完全にコンピューターで生成された音楽である「String QuartetのIlliacスイート」を作成しました。コンピューターは、作曲家のレジャレン・ヒラーと数学者のレナード・アイザクソンによってこのタスクを実行するようにプログラムされました。 :V – VII 1960年、ロシアの研究者であるルドルフ・ザリポフは、URAL-1コンピューターを使用して、アルゴリズム音楽構成に関する世界初の論文を発表しました。

1965年、発明者のレイ・クルツヴァイルは、音楽パターンを認識し、それらからの新しい構成を統合できるソフトウェアを開発しました。コンピューターは最初にクイズショーに登場しました私は秘密を持っています。

1983年までに、ヤマハのKansei音楽システムは牽引力を獲得し、その開発に関する論文は1989年に公開されました。今日でも困難な深い学習の問題と考えられており、ほぼ完璧な転写は依然として研究の主題です。

1997年、音楽知能(EMI)の実験と呼ばれる人工知能プログラムは、バッハのスタイルを模倣した音楽を作曲するタスクで人間の作曲家を上回りました。エミは後に、その作成者にちなんで名付けられたエミリー・ハウエルと呼ばれるより洗練されたアルゴリズムの基礎となりました。

2002年、フランスの作曲家でコンピューター科学者のフランソワパシェが率いるパリのソニーコンピューターサイエンス研究所の音楽研究者グループが、ライブミュージシャンが停止した後に作曲を再開できるユニークなアルゴリズムである継続者を開発しました。

エミリー・ハウエルは、2009年にDarkness、Lightから最初のアルバムをリリースすることで音楽AIの改善を続けました。それ以来、さらに多くのAI Worksがさまざまなグループによって公開されています。

2010年、Iamusは、独自のスタイルでオリジナルのモダンなクラシック音楽を作成した最初のAIになりました。「Iamus 'Opus 1」。スペインのマラガ大学(マラガ大学)に位置するコンピューターは、さまざまな音楽スタイルで完全にオリジナルの音楽を生成できます。 2019年8月、それぞれ独自の歌詞とメロディーを備えた12,197のMIDI曲の大規模なデータセットが作成され、深い条件付きLSTM-GANメソッドを使用して、歌詞からNeally Hearing Melodiesの実現可能性を調査しました。

生成AIの進歩により、モデルが出現し始め、シンプルなテキストの説明から完全な音楽作曲(歌詞を含む)を作成できます。この分野の2つの注目すべきWebアプリケーションは、2023年12月に発売されたSuno AIと、2024年4月に続いたUdioです。

ソフトウェアアプリケーション

チャック

プリンストン大学でGe WangとPerry Cookによって開発されたChuckは、テキストベースのクロスプラットフォーム言語です。音楽作品に見られる理論的手法を抽出して分類することにより、ソフトウェアは学んだ技術に基づいてまったく新しい作品を合成することができます。このテクノロジーは、スローク(スタンフォードラップトップオーケストラ)とプローク(プリンストンラップトップオーケストラ)で使用されています。

ジュークボックス

Jukedeckは、ビデオで使用するためにオリジナルのロイヤリティフリーの音楽を作成するために人工知能を使用できるようにするウェブサイトでした。チームは2010年に音楽生成テクノロジーの開発を開始し、2012年にその周辺の企業を設立し、2015年にウェブサイトを公開しました。使用された技術は当初、ルールベースのアルゴリズム組成システムであり、後に人工ニューラルネットワークに置き換えられました。このウェブサイトは、100万枚以上の音楽を生成するために使用されており、それを使用したブランドには、ロンドンのコカコーラ、Google、UKTV、The Natural History Museumが含まれています。 2019年、同社は条例により買収されました。

モルフェウス

モルフェウスは、ロンドンのクイーンメアリー大学のドリエン・ヘレマンズとエレイン・チューによる研究プロジェクトであり、EUマリー・スカウドフスカ・キュリー・プロジェクトの資金提供を受けています。このシステムは、可変近隣検索アルゴリズムに基づいて最適化アプローチを使用して、既存のパターン化されたフラグメントを、フラグメント全体で動的に変化する特定の音色応力を持つ新しいフラグメントに変換します。この最適化アプローチは、パターン検出技術を統合して、生成された音楽の長期的な構造と繰り返しのテーマを確保します。モルフェウスが作曲した作品は、スタンフォードとロンドンの両方でコンサートで演奏されています。

アイヴァ

2016年2月にルクセンブルクで設立されたAivaは、あらゆる種類のメディア向けのサウンドトラックを作成するプログラムです。 AIVAの背後にあるアルゴリズムは、深い学習アーキテクチャに基づいています。 Aivaは、2018年のアルバムI Am AIのために歌手Taryn Southerとコラボレーションして、Love Siscと呼ばれるポップチューンと同様に、Edgeと呼ばれるロックトラックを構成するためにも使用されています。

グーグルパープル

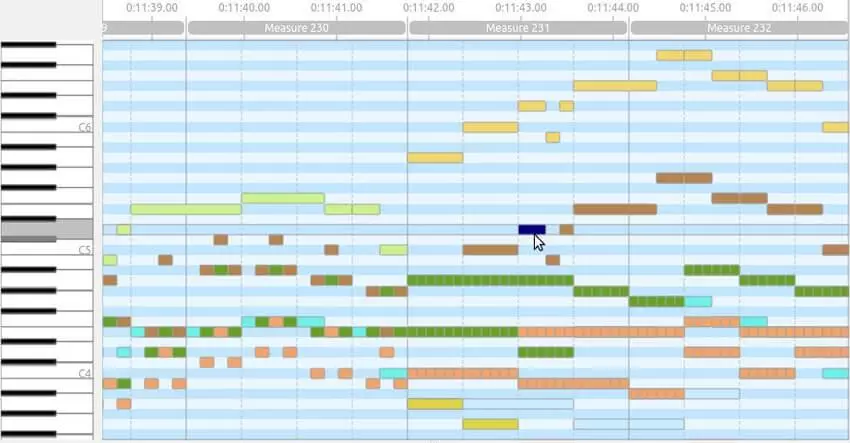

GoogleのMagentaチームは、2016年の発売以来、いくつかのAIミュージックアプリとホワイトペーパーを公開しています。2017年には、ミュージシャンがアルゴリズムを使いやすくするように設計されたオープンソースハードウェア楽器であるNSYNTHアルゴリズムとデータセットをリリースしました。この楽器は、グライムズやヨットなどの著名なアーティストによってアルバムに使用されています。 2018年、彼らはピアノジーニーと呼ばれるピアノ即興アプリをリリースしました。その後、音楽プロデューサーがDAWで既存の音楽を開発できる5つのMIDIプラグインのセットであるMagenta Studioが続きました。 2023年、彼らの機械学習チームは、彼らが開発した独自のテキストから音楽のジェネレーターであるMusicLMを説明するGitHubに技術論文を発行しました。

リフュージョン

Riffusionは、Seth ForsgrenとIke Martirosによって開発されたニューラルネットワークで、音声ではなくサウンドパターンを使用して音楽を生成します。それは、スペクトログラムのテキストキューから画像を生成するための既存のオープンソースモデルである安定した拡散の微調整として作成されました。これにより、テキストキューを使用して、逆フーリエの変換およびオーディオファイルに変換できる画像ファイルを生成するモデルが生成されます。これらのファイルはわずか数秒の長さですが、モデルは出力間の潜在スペースを使用して、異なるファイルを一緒に補間することもできます。これは、IMG2IMGとして知られる安定した拡散モデルの機能を使用して達成されます。結果として得られる音楽は、「de otro mundo」(異世界)と呼ばれていますが、人間の音楽に取って代わる可能性は低いです。このモデルは2022年12月15日にリリースされ、コードもGitHubで自由に利用できます。安定した拡散に由来する多くのモデルの1つです。 Riffusionは、AIベースのテキストから音楽の発電機のサブセットとして分類されます。 2022年12月、ムバートは同様に安定した拡散を使用して、記述テキストを音楽ループに変えました。 2023年1月、GoogleはMusicLMと呼ばれる独自のテキストから音楽のジェネレーターに関する論文を公開しました。

スパイクAI

Spike AIは、Spike Stentが息子のJoshua Stentと友人のHenry Ramseyと協力して開発されたAI駆動のオーディオプラグインで、混合中の明確さやその他の側面について追跡と推奨事項を分析します。通信は、Spike Stentの個人データでトレーニングされたチャットボットを介して実行されます。プラグインは、デジタルオーディオワークステーションに統合されます。

音楽アプリケーション

人工知能は、作成者から与えられたキューに基づいてトラックの反復を生成することにより、生産者が音楽を作成する方法に影響を与える可能性があります。これらのキューにより、AIはアーティストが達成しようとしている特定のスタイルに従うことができます。

AIは音楽分析でも使用されており、機能抽出、パターン認識、音楽の推奨に使用されています。

構成

人工知能は、作曲家/生産者のアイデアに影響を与えており、業界を新参者にとってよりアクセスしやすくする可能性があるため、作曲部門に大きな影響を与えてきました。音楽の開発により、プロデューサーとのコラボレーションですでに使用されています。アーティストは、このソフトウェアを使用して、アイデアを生み出し、音楽スタイルを特定するのに役立ち、AIにニーズに合った特定の要件に従うように促します。構成に対する技術の将来の影響には、スタイルのエミュレーションと融合、および修正と改良が含まれます。これらのタイプのソフトウェアを開発することで、新人が音楽業界に簡単に参入できるようになります。 ChatGPTのようなソフトウェアはプロデューサーがこれらのタスクを実行するために使用しましたが、Ozone11のような他のソフトウェアは、マスタリングなどの時間のかかる複雑なタスクを自動化するために使用されました。

リスクと害

ミュージシャン、プロデューサー、その他は何年もの間、非創造的なAIツールを使用してきました。シェールは四半世紀以上前に「信じる」ことでオートチューニングを普及させ、その後数え切れないほどのアーティストがそれを使用してトーンを「修正」しました。レコードラベルは、AIを使用してソーシャルメディアをスキャンして、オーディオを認識することに関しては同じように機能します。エンジニアはそれを使用して、混合プロセスとマスタリングプロセスを合理化します。最近では、ゲットバックディレクターのピータージャクソンはテクノロジーを使用して、個々のトラックを混合録音から分離し、スタジオの会話を再構築し、ロストビートルズの曲を作成しました。

しかし、これらの補助ツールとSunoやUdioなどの生成AIアプリには重要な違いがあり、ほんの数語から曲全体を作成できます。すべての新しい音楽AIは少し異なって機能し、進化し続けますが、一般に他の生成AIツールと同様の方法で動作します。巨大なデータセットを分析し、その中にあるパターンを使用して確率的予測を行います。

これをオーディオのために行うために、開発者は曲の膨大なコレクションを収集します(ライセンス所有者との契約を通じて、および/または公開されたデータを許可なしに削ることにより)と関連するメタデータ(アーティストと曲のタイトル、ジャンル、年、説明、注釈、関連するものはすべておよび利用可能)。これらはすべて、このデータが巨大な規模でこのデータに注釈を付けるグローバルサウスの低賃金労働者によって可能になります。

その後、開発者はこのデータセットを機械学習モデルのために準備します。これは(要するに)、それぞれが数値の「重み」を割り当てた広大な接続のネットワークです。その後、人間はモデルを教えて、データセットのパターンを観察し、予測を採点することでモデルにフィードバックを提供するように指示します。これらのパターンに基づいて、モデルは短いオーディオまたはテキストキューを取り、次に何が起こるべきか、そしてその後何が起こるかなどを予測できます。

開発者は、重みを微調整して、同じ入力からよりリスニング可能で予測可能な結果を生成します。 AIを搭載した音楽ジェネレーターは、2つのテクノロジーを組み合わせています。これは、専門家が何十年もスタジオで使用してきた音楽ツールと、日常のユーザーが自分の力を活用できる大規模な言語モデルです。 AIミュージックジェネレーターは、トレーニングされているデータと同じくらい優れています。これらのシステムには膨大な量のデータが必要であり、バイアスデータセットで訓練されたモデルは、その出力のバイアスを再現します。誰の声がこの巨大な音楽の箱に含まれていて、誰が取り残されていますか?今日のAIモデルは、特にレコーディングテクノロジーよりも先にあり、非西洋起源の音楽の伝統から、大量の音楽を排除する傾向があります。現在設計されているように、彼らは革新的でも興味深いことは言うまでもなく、異常なものよりも、ジャンルやスタイルの中でステレオタイプのサウンドを生成する可能性が高くなります。生成AIシステムは平凡になりやすいですが、超越的な音楽はフリンジにあります。

「ミュージシャンが世界の文化と言語のほとんどを除外する選択的なデータセットで訓練された予測モデルに依存して依存し始めた場合、人間の創造性と多様性で何が失われるでしょうか?」ラトガーズ大学の重要なAIイニシアチブの議長であるローレン・ミー・グッドラッドは私に言った。

法的な観点から、AIモデルが自分の作品から学ぶのを見ているミュージシャンは、ニューヨークタイムズ、ゲッティ、およびAI企業を訴えている他の出版社やクリエイターと同じ懸念を持っています。一部の企業は、ライセンスされたデータのみでモデルを訓練するように注意していますが、他の企業は手に入れることができるものを何でも使用しています。米国の支配的な音楽貿易機関であるRIAAは、現在、「著作権侵害…大規模な」ためにスノとウディオを訴えています。 (開示:Vox Mediaは、Openaiとパートナーシップ契約に署名したいくつかの出版社の1つです。私たちの報告は編集的に独立しています。)

世論調査では、ほとんどの人が許可なく公開データをコピーしているAI企業を不承認にしていることをしばしば示しています。しかし、テーブルには多くの有名な訴訟がありますが、法制度が彼らを許可なしにすべての創造性を採掘する企業にどのように影響するかはまだ明らかではありません。これらの慣行がすぐに抑制されない場合、最も綿密なプレイヤーはすぐに権力を獲得し、それに伴う派手なロビイストや弁護士が獲得します。 (Carousness:マシンだけではありません!)これらの問題は、時間の経過とともに解決するのが難しくなり、フィールド内の一部が押し戻されているため、今では差し迫っています。 Ed Newton-Rexは、昨年秋にAIを搭載した音楽とサウンドジェネレーターであるStable Audioを発売したときに、Stability AIのオーディオ担当副社長でした。

彼は数ヶ月後、データ収集に関する姿勢について数か月後に会社を去りました。ニュートンレックスのチームは、ライセンスデータでのみ安定したオーディオを訓練しましたが、同社のリーダーシップは、AI開発が「許容可能であると米国の著作権局にパブリックコメントを提出しました。 、フェアユースによって保護されている既存のコンテンツの変革的で社会的に有益な使用。」免許不要のスクレイピングと戦うために、Newton-Rexはかなり訓練された設立され、AI企業が使用するデータセットを検証および認証します。今のところ、非営利団体は、会社のデータセット内のコンテンツが適切にライセンスされているかどうかのみを証明できます。いつか、それはより細かい詳細(アーティストがそのような使用に明示的に同意したかどうかなど、単にオプトアウトしなかったかなど)や、バイアスを緩和するなどの他の問題を考慮することができます。

合唱音楽とピアノ音楽のミュージシャンで作曲家として、彼はこれをフィールドのターニングポイントと見なしています。 「生成AIモデルは通常、トレーニングデータと競合しています」とNewton-Rex氏は述べています。 「正直なところ、人々は音楽を聴くのに限られた時間しかありません。ロイヤルティの限られたプールがあります。そして、これらのシステムを通じて作成される音楽が多いほど、人間のミュージシャンにはなりません。」

FTC議長のリナ・カーンが先月述べたように、人がAI会社がコピーするコンテンツまたは情報を作成し、AIジェネレーターによって生成されたコンテンツまたは情報が「市場から追い出されて迂回するために、元の生産者と競合する場合」ビジネス…それは不公平な競争の方法である可能性があります」と反トラスト法に違反しています。

マーク・リボットは、今年初めに慣行に反対するアーティスト・ライツ・アライアンスの声明に署名した200人以上のミュージシャンの一人であり、彼は音楽労働者同盟のAI運営委員会の積極的なメンバーです。 1970年代から練習中のギタリストであるRibotは、テクノロジーが業界をどのように形成しているかを見て、数十年にわたって記録予算が着実に縮小しているのを見ています。

「私はテクノロジー自体に反対していません。 90年代に彼が作成したマスターレコーディングを失った彼自身が、AIを使用して最終ミックスから個々のトラックを分離しました。しかし、彼は現在の瞬間を、それを所有する企業がそれを規制するには大きすぎる前に、テクノロジーに反対する重要な機会だと考えています。

「有用なものと悲惨な間の本当の分割線は非常に単純です」とリボットは言いました。 「音楽のプロデューサーが、[トレーニングデータとして]入力されている他のものが、実際の機能的な同意権を持っているかどうかはすべてです。 [AI Music Generators]彼らが消費するものを吐き出し、多くの場合、彼らは著作権で保護された素材の大きな塊で物を生産します。それが出力です。しかし、たとえそうでなくても、出力が侵害されていなくても、入力自体が侵害されています。」

リボットは、ミュージシャンは長い間AIに無関心であると述べたが、過去数年間で「デジタル搾取の問題に対する態度の地震の変化」を見た。 、そして監視資本主義と市民の自由のより深い理解。

ミュージシャンはほんの数年前にお互いを競合他社として見てきたかもしれませんが、パイが小さくなっても、金持ちになることができるアーティストがまだ数人いますが、AIは、最も幸運なことでさえ利益を得ることができない業界全体に脅威をもたらします。彼ら。

AIができることとできること

人工知能によって作成された音楽の最初の例の1つは、1956年にさかのぼります。イリアックIコンピューターによって作曲され、イリノイ大学がアーバナシャンペーン教授のレジャレンヒラーとレナードアイザクソンのイリノイ大学によってプログラムされた弦楽四重奏団の作品。

近年の技術的な飛躍に続いて、ホリー・ハーンドン、アルカ、ヨット、タリン・サザン、ブライアン・イーノなどのアーティストは現在、創造的な実践を実験するために生成AIを使用しています。 「幻覚」やその他の無意味な結果を生み出すAIの傾向は、他の文脈では危険ですが、音楽のインスピレーションの源となる可能性があります。他のオーディオテクノロジーが不協和音、CD歪み、8ビット圧縮、喉を発するの喉に強力すぎるように、「それらを記録することを意図した媒体にとって重要すぎるイベント」、ブライアンとして、他のオーディオテクノロジーが定義されるようになったようにイーノは、腫れた付録でその年に書いています。それが最も明確なときに、AIに生成された音楽は最も価値があるかもしれません。コンピューターサイエンスの博士号を持つミュージシャンであるIvan Pazは、彼自身のライブパフォーマンスのためにAIシステムを開発しています。

空白の画面から始めて、彼はコードをリアルタイムで書き込み(聴衆が読むために表示されます)、それが作る音に応答することでモデルをトレーニングします。結果は、楽器を演奏することに少し似ていますが、別のミュージシャンとの即興演奏のようなものです。 「アルゴリズムが非常に低いレベルで動作している場合、たとえば合成のパラメーターなど、実際に微調整しているため、楽器を演奏しているように感じます」とパズは言いました。 「しかし、アルゴリズムが音楽の形を決定している場合、それは次に何が起こるかを決定しているエージェントと遊ぶようなものです。」

今年初めにバルセロナで開催された現代文化センターでの展示会で、パズは歌手マリア・アルナルと協力して、彼女の声の音色レンダリングモデルを作成しました。彼らは訪問者に歌の短いスニペットを歌うように頼みました。その後、モデルはそれらの声をArnalの声と混合して、新しい歌声を作成しました。別のプロジェクトでは、パズの同僚であるシェリー・ノッツは、自分の作品の繰り返しを避けるために自分の作曲のモデルを訓練しました。それは彼女の音楽を分析してパターンを検出しますが、彼女の最も可能性の高い動きを示唆する代わりに、それは継続の可能性が低いことを示唆しています。

AIの音楽の進化の次のステップは、処理速度に至る可能性があります。一部のタイプのモデルではライブコーディングが可能ですが、音楽をレンダリングするには時間がかかりすぎてライブショーで作成できます。シンセサイザーのような電子機器は、もともとアコースティックサウンドを模倣するように設計されており、時間の経過とともに独自のキャラクターを開発しました。 Pazは、生成AIの究極の可能性は、私たちが現在想像できない新しいサウンドを作成することは言うまでもなく、プロデュースは言うまでもありません。この文脈では、AIがパフォーマーを支援する - AIは、デジタルチューナーやペダルを遅延させるよりもミュージシャンを「交換」する可能性は低くなります。

ただし、音楽業界の他のコーナーは、より破壊的な目的でAIを採用しています。 AIは人間よりも音楽を作ることはできません(そして決してできません)が、今でははるかに速い速度で、より速い速度で許容可能な音楽を作成できるようになりました。多くの場合、トラックがクリアしなければならない唯一のバーです。

ほとんどの場合、音楽を聞くと、誰がそれを作成したかわかりません。広告で聞こえるジングル。映画やテレビ番組、ポッドキャスト、ビデオゲームのアンビエントスコア。ループヒップホッププロデューサーのサンプルはビートにサンプリングします。これは、生成的AIによって乱される可能性が最も高い業界の一部です。ブルームバーグは、教師がSunoを使用して音楽ティーチャーエイドを作成していると報告しています。 Gizmodoは、AIを搭載したもう1つの音楽ジェネレーターであるAdobeのProject Music Genai Controlのターゲットオーディエンスは、PodcastersやYouTuberのように、ムード、トーン、長さを指定する機能を備えたバックグラウンドミュージックを迅速かつ安価にしたい人であると指摘しています。トラック。

あなたがそれが好きであろうと気づいているかどうかさえ、これらのタイプの音楽は歴史的に人間によって作成されてきました。しかし、自動化されたAI音楽世代は、これらのミュージシャンの仕事に費用をかける可能性があります。彼らの多くは、その収入を使用して、より創造的に満足のいく、しかし財政的に実行可能でない追求をサポートしています。ステージにAIミュージシャンを見ることはないかもしれませんが、テクノロジーのために人間のミュージシャンが少ないでしょう。

彼らにとって、音楽業界の影響力のあるプレーヤーは、AIが彼らのビジネスの主力になるとすでに信じています。彼らは誰が利益を享受するのか心配しています。 Spotifyは、訴訟を危険にさらしている模倣でない限り、AIに生成された音楽を制限しません。 Universal Music Group(UMG)とYouTubeは、UMGアーティストとAIツールを開発するためにYouTube Music AI Incubatorを立ち上げました。一方、UMGは、ASCAP、BMI、RIAA、AFL-CIOを含む150を超える組織の1つであり、クリエイティブフィールドでのAIを使用するための倫理的枠組みを確立しようとするHuman Artistry Campaign Coalitionの1つです。彼らはテクノロジーを禁止したくありませんが、結果への利害関係を望んでいます。

毎日100,000を超える新しいトラックがストリーミングサービスにアップロードされているため、デジタルストリーミングプラットフォームは、ユーザーがプレイする人間で作られたロイヤリティのないトラックのシェアを削減するための強力なインセンティブを持っています。 Spotifyだけでも、昨年は90億ドルのロイヤリティを支払い、140億ドルの収益の大部分を支払いました。世界最大の音楽ストリーミング会社は、歴史的に無料のトラックの可用性と可視性を高めており、引き続きそうする可能性があります。 AIを搭載した音楽ジェネレーターは、人気のあるプレイリストから本物のロイヤリティを獲得するアーティストを追い払うことができる無料の音楽を作成する簡単な方法であり、そのストリーミング収益をアーティストからプラットフォーム自体に移します。

確立されたアーティストには、新しい力と新しい危険があります。脳卒中の後、カントリースターのランディトラビスは、歌うことは言うまでもなく話すのに苦労していますが、AIの助けを借りて既存のカタログで訓練されているので、彼はボーカルをデジタルで再現できます。

一方、匿名のプロデューサーは、信じられるもののドレイク/The Weeknd Collaborationを作成し、何百万ものストリームを獲得できます。 5月、プロデューサーのメトロブーミンは、ケンドリックラマーとのドレイクの実生活の牛肉の間に発砲しました。 Metro Boominは、誰でも使用できるAIに生成されたサンプルでビートをリリースしました。ドレイクはサンプリングしてラップし、新しいトラックをストリーミングサービスにリリースしました。ウディオを使用してメトロブーミンがリミックスしたオリジナルのトラックを作成したウィロニウス王は、彼の貢献の権利を保持するために弁護士を雇いました。

これらの最新の例は、音楽がどのようにすぐに作られて音楽がうまくいっているかを示しています。ストリーミングエコノミーでは、ボリュームとスピードがすべてです。アーティストは、品質ではなく量を生産するように奨励されています。

「[将来のAIに生成されたヒット]は、人々が戻って、記録時代の大きなリリースでやり続ける方法を研究するものではありません」とミュージシャンのジェイミー・ブルックスは言いました。ブルックスは、彼女自身の名前で、バンドのエリート体操とデフォルトの性別、そして彼女のニュースレター「The Seat of Loss」の音楽業界に関するブログでレコードをリリースしました。 「しかし、それはまだエンゲージメントを生み出しているので、Spotifyチャートの一番上にあるものは何でも続くことを意図していない世界です。 。彼らはお金を稼ぐためにそれを芸術にする必要はありません。

」今日のテクノロジーの多くは、主に模倣または単純化するために存在し、それはアマチュアリズムを促進する可能性があります。ファイル共有により、強制的なレコードがハードドライブとモデムを持つ人なら誰でもアクセスしやすくなり、携帯電話カメラは群衆の全員がショーを文書化できるようになり、ストリーミングオーディオは私たちのムードと広告コホートに合わせたすべてのダイナミックなプレイリストを提供します。生成AIは、非専門家にとっても音楽の作成を容易にする可能性があります。これは、私たちがどれだけの音楽を聞く音楽だけでなく、フォーム全体との関係だけでなく、根本的に変化する可能性があります。ヒット曲を作成するには、バイラルツイートを書く以外に努力を必要としない場合、ソーシャルメディアに現在含まれている創造的なエネルギーの多くは、プロンプトに基づいて音楽の生成にリダイレクトできます。

ブルックスはそれを退行的な現象と見なし、時代を超越した深さを即座に強調し、最も洗練されたリスナーを対象としたオーディオミームと画期的なシングルをトッピングします。 、」野球の試合に行ったことがない2人によって書かれました。

「それがこれらのサービスが音楽を推進する方向です」とブルックスは言いました。 「創造性についてはまったくありません。これらのモデルの仕組みとアルゴリズムフィードの間で、それはすべて過去の大きなリポジトリです。レコードを音で前進させることはありません。アメリカのポップカルチャーの中心からゴミ箱までの記録を加速する予定です。」

著作権とAI音楽

音楽業界でAIを取り巻く最も議論されている問題の1つは、特に既存の著作権で保護された素材を使用してアルゴリズムがトレーニングされている場合、AIに生成された作品からお金を稼ぐ人に関するものです。 2023年3月、米国の著作権局は、AI関連の著作権の問題を調査するためのイニシアチブを開始しました。キャンプは、規制当局が介入してパッチを作成すると確信していますが、アーティストが運営している米国の著作権システムのために、問題を解決するのが難しいことを心配しています。

「最終的に私たちの現代の著作権システムにつながった多くの法律と先例は、今音楽で起こっていることに合わないだけです」とキャンプは言います。 「クリエイターは著者を持つべきであり、クレジットされるべきであり、補償されるべきだと信じています。しかし、繰り返しますが、私たちが行うシステム全体は非常に時代遅れです。」

AI音楽はまだ合法的な灰色の領域にあり、AIテクノロジーを使用した音楽の創造性の可能性を制限することなく、アーティストがクレジット、補償、およびAIによる作品または肖像の使用に同意されている場合に妥協が可能かどうかという疑問を提起します。ある程度、芸術は他の芸術の派生物であり、インスピレーションと盗難は現在ぼやけています。いくつかのレコードラベルが反撃し始めています。

2023年5月、Universal Music Groupは、AIが生成された音楽の使用をブロックするためにストリーミングサービスを呼びかけ、アーティストの音楽を使用してアルゴリズムを訓練し、必要に応じて法的措置を講じると述べました。 Spotifyは、プラットフォーム上でAIに生成された音楽の7%を削除し、数万曲に相当することで応答しました。 2023年7月、UMGは議会に、作成者をAI駆動した著作権侵害から保護するための全国的な政策を制定するよう呼びかけました。レコードレーベルは、AIの責任ある使用を提唱する組織であるHuman Artistryキャンペーンに参加する40人のメンバーの1人です。

米国では、現在の法的枠組みは、人間の創造プロセスとの違いにもかかわらず、従来の著作権法をAIに適用する傾向があります。ただし、AIのみによって作成された音楽作品は、著作権によって保護されていません。著作権局の実践概要では、著作権局は、「人間の作者を欠く作品」や「オフィスは、機械によって作成された作品や、無作為にまたは自動的に動作する単なる機械的プロセスによって作成されない作品を登録しないと述べました。人間の著者からの創造的な意見や介入。」 2022年2月、著作権審査委員会は、「著作権請求を維持するために必要な必要な人間の著者が欠けていた」という理由で、AIに生成された芸術作品の著作権申請を拒否しました。

欧州連合(EU)の状況は、米国の状況に似ています。その法的枠組みは、著作権で保護された作品における人間の関与の役割も強調しているためです。欧州連合知的財産局と欧州連合司法裁判所の最近の判例法によれば、独創性の基準は、作品が著者自身の知的創造であることを要求しています。 、特定のレベルの人間の関与を必要とします。欧州連合のHorizon 2020 Research and Innovationプログラムによって資金提供されたRecreating Europeプロジェクトは、音楽、著作権のルールを尊重しながらイノベーションを促進する法的確実性とバランスの取れた保護を含むAIが生成したコンテンツによってもたらされる課題を掘り下げています。 Aivaの認識は、作曲の分野での作家と著作権に関する伝統的な見解からの大きな逸脱を示しており、AIパフォーマーが音楽をリリースしてロイヤリティを受け取ることができます。この認識により、Aivaは音楽制作におけるAIの正式な認識の先駆者になります。

Stability AI、Openai、Googleなどのグループによる人工知能の最近の進歩により、AI Musicを含む生成技術に対して著作権侵害訴訟が提起されています。これらの訴訟が成功した場合、これらのテクノロジーを強化する機械学習モデルのデータセットはパブリックドメインに限定されます。

ドレイクとウィークエンド

音声クローニングの法的先例はあまりありませんが、有名人にとっては、彼らのイメージ、名前、声の違反として宣伝権に該当する可能性があります。昨年の重要な例の1つは、Ghostwriterという名前のTiktokerがAIを使用して、DrakeとWeekndの間に「Heart on My Sleeve」と呼ばれる偽のデュエットを作成したときでした。その後、歌は削除されましたが、バージョンはまだインターネット上に浮かんでいます。

「一方では、それはオリジナルの作品であると主張することができます」とウェアは言います。 「一方、AIは、彼のカタログを分析することで、彼の明確な許可なしにドレイクのスタイルで歌詞を書くことを学んだので、それは侵害の形と見なすことができました。もう1つの懸念は、アーティストの名前と肖像の不正使用です。」

AIを使用して誰かの名前と肖像をコピーする能力は、音楽業界とエンターテイメント業界全体を悩ませています。現在のSAG-AFTRAストライキの主な要求の1つは、作成者がAIジェネレーターを訓練するために作品を使用することから、俳優が同意なしに類似性と声をコピーすることから保護することです。

AIの倫理的問題

著作権は、AIを取り巻く多くの倫理的問題の1つにすぎません。この技術とその開発には結果がないわけではないことを覚えておくことが重要です。

当面の懸念の1つは、データセットのトレーニングにおけるバイアスです。例は、ラッパーFN Mekaで、2022年にCapitol Music Groupと契約しましたが、後に人種のステレオタイプを永続させたため契約を削除しました。

「大きな問題の1つは、ゴミ入りとゴミが出ることです」とキャンプは言います。 「これらの言語モデル、またはこれらの画像ジェネレーター、または本質的に偏った本質的に人種差別主義者のデータに関するこれらの音楽ジェネレーターをトレーニングする場合、私たちが求めていることはすべて、それらのステレオタイプを永続させるでしょう。良いデータが入っていて、監視していることを確認する必要があります。」

そのデータの監視も害がないわけではありません。別の倫理的懸念は、「強化学習」と呼ばれるトレーニングプロセスです。これには、さまざまな不穏なコンテンツに関する人間のフィードバックを提供します。 Wall Street Journal Podcastの最近のエピソードThe Journalは、ケニアのデータワーカーを特徴としています。ケニアのデータワーカーは、非常に高いメンタルヘルスを犠牲にして「正しいから間違っている」を区別するためにChatGptを訓練しました。

「基本的に、それは親指を立てたり、応答に賛成を下しています」とキャンプは言います。 「これは不適切な反応ですか?あまりにも暴力的でも、グラフィックでも邪魔ですか? Openaiは、その仕事をケニアの人々に契約し、それらの回答を読むために1時間に2ドルを支払いました。ですから、仕事に出て、最も恐ろしく、心理的に不穏なテキストのいくつかを読むために1時間2ドルを支払われることを想像してみてください。あなたは10時間それを行い、それからあなたは家に帰り、それはすべてあなたの頭の中で渦巻いています。ですから、ソーセージが今作られる方法には多くの欠陥があります。」

音楽のディープフェイク

音楽におけるAIのより初期の開発は、オーディオディープフェイクを使用して、既存の曲の歌詞や音楽スタイルを偽造して、別のアーティストの声やスタイルに似ています。これは、特に芸術的アイデンティティの文脈において、テクノロジーの合法性とその使用の倫理について多くの懸念を提起しています。さらに、これらの作品に誰がクレジットされているかという問題も提起しました。 AIは独自の著者を持つことができないため、現在の推測では、一般的な機械学習技術についてさらに決定が下されるまで、明確な答えがないことを示唆しています。最新の予防措置は、GoogleとUniversal Music Groupによって開発され始めました。これは、プロデューサーがアーティストの声とスタイルをコピーできるようにするために、ロイヤリティと信用属性を考慮しています。

「私の袖のハート」

2023年、GhostWriter977として知られるアーティストが「ハートオンマイスリーブ」と呼ばれるミュージカルディープファークを作成しました。オリジナルの歌詞で元のリファレンスボーカルと一致する可能性のある各アーティストの声。このトラックは、最高のラップソングとソングオブザイヤーのグラミー式考慮事項のために提出されました。それはバイラルになり、ティクトクで人気を博し、視聴者から肯定的な反応を受け、2023年4月にApple Music、Spotify、YouTubeの公式リリースにつながりました。ソングライティング、制作、オリジナルのボーカル(変換の前)はまだ彼によって行われました。歌は後にグラミー賞の考慮事項の要件を満たしていないため、後にグラミー賞ノミネートリストから削除されました。このトラックは、Universal Music Groupによってすべての音楽プラットフォームから削除されました。この歌は、人工知能を使用した音声クローニングのターニングポイントであり、それ以来、人気のある歌手やラッパーの数千人ではないにしても数百人のためにモデルが作成されています。

「それがどこから来たのか」

2013年、カントリーシンガーのランディトラビスは、彼が歌うことができなかった脳卒中に苦しみました。一方、ボーカリストのジェームス・デュプレは彼に代わってツアーをし、彼の歌を演奏しました。トラビスと長年のプロデューサー、カイル・レーニングは、2024年5月に「Where That Brom」と呼ばれる新しい曲をリリースしました。レコーディングでは、人工知能技術を使用して、Dupréの録音とともに40を超える既存のボーカルレコーディングから編集されたTravisのボーカルボイスを再現しています。

AIミュージカルツール

AIが何であるか、そしてその主要な欠点のいくつかをカバーしたので、存在するAIミュージカルツールについて説明できます。ボストンのバークリー音楽大学のキャンパスで開催される毎年恒例の音楽会議であるバークリーオンサイト2023年、ウェルズは、知るためにいくつかのAIミュージカルツールを共有しました。今すぐ学習を開始できる人もいれば、学びたいだけかもしれません。

Bandlab Songstarter

BandlabのSongstarter Appは、ジャンルを選択し、Songの歌詞(および絵文字)を入力できるAI駆動の曲ジェネレーターで、無料のアイデアを生成します。その後、それらのアイデアをスタジオ機能に取り入れて、自分で作ることができます。最初のインスピレーションが必要な場合は、曲を始めるのに最適な方法です。

ミッドジャーニー

最も人気のあるAIを搭載した画像ジェネレーターの1つとして、Midjourneyを使用して、アルバムアート、ソングカバー、ポスター、Spotifyループ、マーチイメージなどを作成できます。他のAIを搭載した画像ジェネレーターとは一線を画すのは、シュールな夢のようなスタイルであり、音楽プロジェクトに適している可能性があります。プログラムは使いやすいですが、明確な学習曲線があります。多くの新しい技術プログラムと同様に、飛び込む前にいくつかのチュートリアルをご覧ください。

ミックスモノリス

Mix Monolithプラグインは、Ayaicの自動ミキシングシステムで、ミックスを均一にします。ミックスオンライン記事では、開発者は次のように述べています。「その目的は、完成したミックスを自動的に作成することではなく、トラック間の基本的なゲイン関係を確立し、適切なゲイン調整を確保することです。」

Landr AIマスター

LandrのAIマスタリングツールを使用すると、トラックをプログラムにドラッグアンドドロップできます。これにより、分析し、スタイルとボリュームのシンプルなオプションが提供されます。これら2つのオプションを選択すると、プログラムはトラックをマスターし、ファイルの種類と配布方法のオプションを増やします。 Landrは、プログラムと混合された2,000万台以上のトラックを誇っています。

アイヴァ

Aivaは、歴史から30,000を超える象徴的なスコアで訓練された人工知能プログラムです。現代の映画から20世紀の映画まで、タンゴからジャズまで、いくつかの異なるプリセットスタイルの音楽から選択できます。次に、主要な署名、時間署名、テンポ、計装、期間などを入力するオプションがあります。何を入力すべきかわからない場合は、アイヴァはあなたのためにそれをします。最後に、トラックを生成し、機器をカスタマイズし、さまざまなファイルタイプをアップロードできます。加入者として、作成したすべての著作権ライセンスがあります。

ミュージシャンのためのChatGpt

最も広く使用されているAIツールの1つであるOpenaiのChatGPTには、ミュージシャンにさまざまな用途があります。同社は現在、連邦取引委員会によって調査中であるため、ChatGptと共有する情報について予防策を講じ、ChatGptから受け取った事実を確認する必要があります。

それを念頭に置いて、このプログラムは、実際に音楽を作ることからあなたを遠ざけるタスクに費やす時間を短縮する可能性があります。 WaresとCampは、リリース以来ChatGptを試してきており、ミュージシャンや音楽の専門家が有用であると思われる具体的なヒントをいくつか持っています。

ソーシャルメディア戦略

ソーシャルメディアは、アマチュアのミュージシャンにとって大きなタイムシンクになる可能性があり、ChatGptは負荷を緩和するのに役立ちます。 Waresは、ChatGptに自分がどんなアーティストであるか、どのような音楽のジャンルを演奏し、趣味や興味が何であるかを伝えることから始めることができると言います。次に、Tiktok、Instagram、Facebook、または使用するソーシャルメディアプラットフォームで、今後30日間、30個のコンテンツをリクエストできます。ソーシャルメディアコンテンツのアイデアをリクエストできるだけでなく、ChatGptに最適化されたキャプションとハッシュタグを作成するように依頼することもできます。

ツアーのためのテクニカルライダー

ツアーに行くとき、ミュージシャンは通常、誰かを雇って、ショーをやめるのに必要なすべての詳細を概説するテクニカルライダーを作成します。これには、機器、舞台のセットアップ、サウンドエンジニアリング、照明、ホスピタリティ、ギグ契約、ツアーの旅程、会場のオプション、チケット価格などが含まれます。 Wares氏によると、ChatGptはそのハイテクライダーを書くことができ、最近バンドと協力してテクノロジーを使用してツアーを計画しています。

「私たちは、バックラインの要件、入力の詳細なリスト、さらにはいくつかの簡単なヒントに基づいて、バックライン要件、入力の詳細なリスト、さらには特定のマイクの推奨事項を含むTech Riderを作成することから始めました」とWares氏は言います。 「その後、北東部のツアーの旅程に関する推奨事項、チケットにいくら請求すべきか、バンドのファン層のユニークな興味と人口統計に基づいた商品のアイデアを求めました。数日かかったことは1時間以内に行われました。」

人々はどこにいますか?

歌の歌詞を書くのに役立つ、インスピレーションが必要な場合、またはいくつかの単語の提案を使用したい場合は、ChatGptは便利なソングライティングツールになります。キャンプは、元バークリーの学生であるジュリア・ペリー(AIと音楽に関するバークリー・今の記事のためにインタビューした)と協力して、ChatGptを使用して曲のアイデアを生み出した例を挙げています。

「私たちは、宇宙がどのように魔法であり、彼女が宇宙についてこの深く、知らない真実を表現したかったのかについて話していました」とキャンプは言います。 「そして、私は基本的に、彼女が言ったことすべてを2つか3つの段落に凝縮し、[Chatgpt]と言ったので、この曲の20のオープニングラインをください。」

彼らは、新しい曲の出発点として20のオプションのいずれかを使用することになりました。

コンテンツライティング

ChatGptは、プレスリリースの作成、複数のキャラクターの長さのバイオ、アルバムリリース戦略、ブログ投稿、ウェブサイトのコピー、電子メールなどなど、さまざまなコンテンツライティングおよびコピーライティングタスクを支援できます。

契約と契約

理想的な世界では、弁護士にすべての契約と契約を書いてレビューさせますが、それは必ずしも現実的または手頃な価格ではありません。場合によっては、何も持っていないのではなく、ChatGptドラフトに契約をドラフトすることをお勧めします。これは、管理契約、バンド契約、分割シート、パフォーマンス契約などに使用できます。しかし、繰り返しますが、可能な場合はエンターテインメント弁護士が常に望ましいです。

人々はどこにいますか?

AI Generative Musicの現在の状態は、True Generationよりもミックスアンドマッチです。それは本当にトリビュートバンドではなく、リバイバルへの広大なアプローチです。トレーニングデータにあるものからのみ音を生成することができ、それらの要素を新しい方法で結合、混合、屈折させることができますが、それ以上に実験することはできません。

ミュージシャンは、再生できるノートの数は限られているか、すべての音が周波数と波長の問題であるため、純粋に音楽用語でできることは限られていることしかないことを教えてくれます。しかし、音楽やリズムを配置するだけでなく、材料やテクニックの有限リストから選択するだけでなく、レシピを作成するだけではありません。

リボは、彼の実験と、異なる影響から引き出し、それらを新しいものに混ぜる能力で知られるギタリストです。一見すると、これは生成AIの支持者によって提起された価値提案によく似ていますが、彼は、人間とマシンの間に同じことをしている根本的な違いがあると言います。

「誰かを引用せずに12バーブルースのソロを通過することはできません」とリボットは言いました。 「私たちはそれをするために人権の特権を与えなければなりません。私はいつラインを越えているかを知っているのがかなり上手です。チャーリー・パーカーの歌にならずにチャーリー・パーカーの歌のこの部分を引用できることは知っています。これをひどく台無しにすることができ、クールになることを知っています。」

リボットの1990年のアルバムRootless Cosmopolitansには、Jimi Hendrixの「The Wind Cries Mary」の表紙が含まれています。 Hendrixへのオマージュでは、Ribotのバージョンは抽象的であり、歌詞はスクラッチなギターにbarえ、ギターのトーン以外のオリジナルの曲にほとんど似ていない、Hendrixのメロディー、コード、リズムを省略します。それでも、リボットはそれをアルバムの表紙としてリストし、すべての販売やストリームに機械的なロイヤリティを支払います。

「このシステムは保存する必要があり、それは戦う価値があります」とリボットは言いました。 「記録に座っているとき、私たちは最低賃金を支払われていません。パフォーマンスをしている場合でも保証はありません。 [著作権]は、文字通り私たちが持っている唯一の経済的権利です。」

リボットの議論の実践は、長い伝統の一部です。媒体としての音楽は、以前に来たものに対する認識と尊敬、まだ成長し、変化することができるものによって定義されます。 「音楽の変化を促進するのは、人々の気分、彼らのニーズと可能性の変化、そして彼らが好きなもの、そして彼らを怒らせるものです。人々は、感情、出来事、そして自分の人生の充実をとり、ギターやピアノでそれらを代表することを学ぶことができます。エクスペリエンスが拡大し、歴史が長くなり、バンドが表現とアイデアを必要とするバンドが出現するにつれて、フィールドを拡張します。」

歴史的に、真正性と人類を暗示するミュージシャンと聴衆の間に神聖な契約がありました。 ERASツアーに参加した数百万人のテイラースウィフトファンのうち、多くの人があなたに彼女の個人的な生活の詳細な説明をすることができました。同じことは、ビヨンセ、ハリー・スタイルズ、エルトン・ジョン、または最大のツアーアーティストの観客にも当てはまります。スタジアムを売り切れるには実在の人が必要です。マスクされていないときにパフォーマーを認識しているとは思わなかった場合、マスクされた歌手を見ることすらできませんでした。

意図的に音楽を聴くとき、私たちはしばしば、歌が他の人の経験や視点を理解するより大きな空間への出入り口であるかのように、相互に耳を傾けています。 nirvanaを検討してください。グランジの美的逸脱は、適切な瞬間に近代的なスタジオテクノロジーに会ったため、Nevermindは、それが聞こえるだけでなく、Kurt Cobainの個人的な弧、つまり、不安な郊外の子供の流星の上昇と悲劇的な早期死であるため、それが聞こえるだけでなく、巨大な聴衆を見つけました。公然と挑戦的な(一部の)ポップスターコンベンションによるロックスーパースターは、人々と共鳴しました。

バンドは、ピクシー、ギャップバンドなどにインスピレーションを与えたミュージシャンを認めましたが、ニルヴァーナのレコードは、最終的にはコバーン、彼のバンドメイト、および彼らの協力者による選択のユニークな製品であり、彼らの経験と理想の表現と反映です。 。アートは、定義上、人間の意思決定の産物です。

他の形式の音楽プロセスと同様に、一部のAIに生成された音楽は、その人間の要素を保持しています。IvanPazやShelley Knottsのようなアーティストが自動モデルに大きく依存しているため、システムを作成し、それがどのように機能するかについて無数の決定を下し、何を決定するかを決定するそれが生成するどんな音でも。

しかし、人間のミュージシャンを脅かすAIミュージックは、少数の言葉以上の言葉をかけず、彼らから曲全体をプロデュースしますが、それはそのデータからの間に時間的にしか見えるだけでなく、決して外に出ないので、決して前進することはないため、本質的に制限されています。ギターは何世紀も前に発明されましたが、1940年代の妹ロゼッタ・タルペの全盛期の前に音楽を訓練したAIモデルは、エレクトリックギターに似たものを生産する可能性は低いです。ヒップホップは、他のアーティストの作品のサンプリングと再パッケージに基づいた音楽のスタイルです(元のアーティストが好まない形やコンテキスト)が、1973年以前に音楽で訓練されたモデルは、それ。

人々が音楽を聴く理由は無数にありますが、人々がそれを作るのと同じくらい多くの理由があります。人々は何千年もの間お互いに音を出してきており、そのほとんどの間、そこから生計を立てることを想像することは愚かだったでしょう。それを記録することはもちろん、それを増幅することさえ考えることさえ不可能だったでしょう。とにかく人々は音楽を作りました。

ここにはAIよりも緊張があります。一方では、レコードラベルとデジタルストリーミングプラットフォームは、音楽市場が何よりも認識を望んでいると主張していると考えています。 2021年の米国の音楽市場の割合。チャートトッパーはますます似ているように聞こえます。ストリーミングプラットフォームアルゴリズムは、多くの場合、同じ曲を何度も何度も供給します。

一方、驚き、革新、違反に対する本質的な人間の必要性があります。それは人ごとに異なります。基本的には、基本的にはスケーリングと監視と監視の目標は、ユーザー全体と個人の目標とは異なり、ユーザーベースが大きくなればなるほど、自動化する傾向があります。 AIミュージックジェネレーターも動的に生成されたプレイリストも、他のアルゴリズム的に予測的なシステムも本質的に良いか悪いかを示していません。

しかし、何が起こっても、音楽を独占する会社はありません。種はありません。鳥はそれをします。ミツバチはそれをします。海のクジラはそれをします。その一部は、人間の耳に非常に美しいです。しかし、そのすべての自然なメロディーがあっても、すべての音楽人がすでに作成しており、AIが自分自身を作成または作成するのに役立つすべての音楽は、自分自身を創造し、表現するという衝動が続きます。商業主義以外の理由で音楽が私たちの世界に存在します。

多くの場合、その理由は非常に単純です。人や人々のグループは、それが存在するはずだと判断し、それを作りました。機械がどれだけの音のスラッジを汲み上げても、それは存在し続けます。

抱きしめるか抵抗しますか?

AIやその他の新興技術に関しては、繰り返されるテーマの1つは、それらが将来の音楽業界(およびほとんどの業界)の大きな部分になることであり、それらを無視することは業界の将来のリーダーを助けないことです。

「AIは、生徒がより生産的であり、創造的なプロセスをサポートするのを助け、音楽を作成して演奏したり、新しいビジネスのアイデアを探索したりすることで、生徒が最も重要なことに集中できるようにすることができると思います」とWearは言います。 「しかし、責任ある教育者として、私は生徒がこれらのツールにあまりにも依存しないようにしなければなりません。私は常にAIを使用して批判的思考スキルの開発を支援する方法を探しています。」

キャンプは同意し、AIが進化し続けるにつれて、人々が快適なことをするように人々を奨励します。

「私は確かにあなたを奨励します。最新の状態を維持し、テクノロジーを使用して地球上のものを前進させたい場合は、そうです」とキャンプは言います。 「しかし、私が言ったように、私には固定電話を使う友達がいます。ビニールレコードを購入することを好む友達がいます。 AIはここにあります。それは大きな影響を与えます。使用する必要はありませんが、多くの人が選択します。」

バークリーオンラインのai

最近、Berklee OnlineはAria:Ai-Enhanced Realities&Immersiveアプリケーションと呼ばれるイニシアチブを立ち上げました。このプロジェクトは、バークリーオンラインのサポートおよびオーディオテクノロジーのアソシエイトディレクターであり、バークリーカレッジオブミュージックの卒業生であるGabriel Raifer Cohenが率いています。

「それ以前の計算機、コンピューター、インターネット、検索エンジンのように、Genaiは滞在するためにここにいます」とRaifer Cohen氏は言います。 「これらのツールのすべてが容易に入手できるという現実を無視することは、学生に害を及ぼすことです。 。 。 。生徒に、これらのテクノロジーをエンパワーメントのツールとして、そして責任を持って最善を尽くし、責任を持って教えることは、彼らと戦おうとするよりも価値のある努力かもしれません。」

そして、AIが音楽業界の将来に大きな役割を果たすからといって、この新しいテクノロジーを批判したり、安全対策を提唱したりできないというわけではありません。 「同時に、私たちは、倫理的に認識し、積極的に維持されながら、genaiの心のない使用によって促進される平凡さと創造的な無感覚の広がりに抵抗しなければなりません」と彼は言います。 「これには簡単なことはありませんが、AIの開発は、潜在的に変革的な教育体験の機会も開かれていると考える必要があります。」 Raifer Cohenは、ARIAイニシアチブの一環として、Berklee Onlineはこれらの新しいツールを探求し続け、彼らがテストされ、徹底的に研究された後にのみ、学校は教室でそれらを実装することを検討すると述べています。 「最終的に、学生や教師、視聴者、クリエイターにとって、これらの強力なツールはすべてそれだけであることを忘れてはなりません。